La Falsa Empatía de ChatGPT: ¿Podría la IA engañarnos en nuestras emociones?

2024-11-23

Autor: José

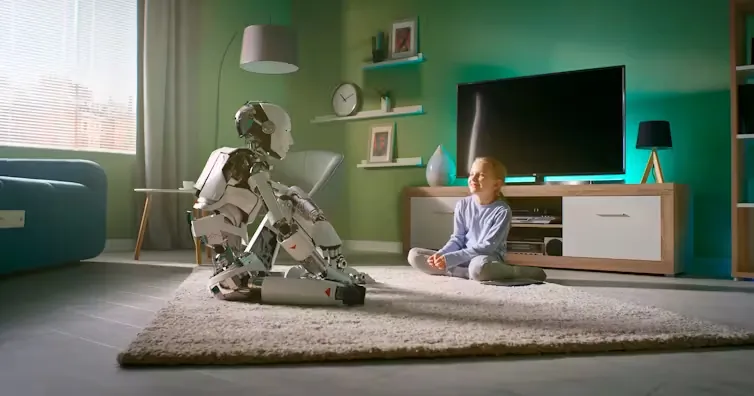

Sábado, 23 de noviembre de 2024. El antropomorfismo es una tendencia que nos lleva a atribuir características humanas a entidades no humanas, como máquinas o animales. En el contexto de los chatbots, como ChatGPT, Gemini o Copilot, este fenómeno se manifiesta cuando imitan el lenguaje humano para interactuar con nosotros. No solo usan palabras y frases comprensibles, sino que también adoptan patrones de comunicación típicos de los seres humanos, logrando mantener conversaciones coherentes, incluso agregando humor y, sorprendentemente, empatía.

Este diseño del lenguaje en las máquinas busca hacer que la interacción con ellas sea natural y accesible. Esto resulta esencial para aplicaciones que van desde el servicio al cliente hasta la educación y el entretenimiento. Pero aquí viene la pregunta inquietante: ¿realmente comprenden lo que dicen, o simplemente repiten patrones aprendidos?

Durante mucho tiempo se creyó que la capacidad de usar el lenguaje era exclusiva del ser humano. Sin embargo, los avances en inteligencia artificial generativa desafían esa noción y nos llevan a replantearnos las implicaciones éticas de estas tecnologías.

Uno de los rasgos distintivos del lenguaje humano es la subjetividad, expresada en la elección de palabras con carga emocional y la manifestación de opiniones personales. Esto incluye cómo evaluamos eventos y los elementos contextuales y culturales que influyen en la comunicación.

El Impacto de la Primera Persona

Cuando un chatbot simula ser humano, emergen importantes implicaciones éticas y psicológicas. Las interacciones que tienen lugar con estas máquinas pueden alterar nuestra percepción y relación con la tecnología. Por ejemplo, el uso de pronombres personales, especialmente la primera persona, puede crear un sentido de intimidad y conexión que, a largo plazo, puede hacer que las personas desarrollen apego emocional hacia estas máquinas.

Imaginemos esta interacción: Usuario: “¿Cómo debo decidir qué artículos conservar, donar o tirar al organizar mi espacio?” Chatbot: “¡Esa es una excelente pregunta! Organizar tus pertenencias puede resultar abrumador, pero con un plan claro podrás tomar mejores decisiones. Aquí tienes algunas sugerencias para priorizar qué conservar, donar o tirar.”

En el caso del chatbot, aunque no use explícitamente “yo”, la forma de comunicarse insinúa una posición de guía, haciendo que el usuario se sienta valorado y apoyado. ¡Increíble, pero inquietante! Esto resalta cómo la tecnología puede jugar con nuestras emociones.

La Fundación de la Segunda Persona

El uso del “tú” invita al usuario a participar activamente en la conversación, lo que se puede ver en frases como “Organizar tus pertenencias puede ser abrumador” y “con un plan claro, podrás decidir mejor.” Al hablar de manera tan personal, el chatbot no solo da consejos, sino que busca también involucrar al usuario emocionalmente.

Además, comentarios como “¡Excelente pregunta!” no solo validan la consulta, sino que también incentivan la participación del usuario. Esto crea una sensación de que el chatbot entiende sus emociones, aunque en realidad solo sea una simulación. Esta ilusión de empatía puede condicionar nuestra manera de interactuar con otros humanos.

Los Efectos de la Empatía Artificial

Al utilizar la primera persona, los chatbots están imitando una forma de conciencia que puede crear confusión. Al involucrar al usuario con la segunda persona, se convierte en una conversación que se siente más humana y cercana. Sin embargo, esta “empatía” proviene de algoritmos, no de un entendimiento real.

Con el tiempo, estas interacciones pueden difuminar los límites entre lo humano y lo artificial. Podríamos llegar a tratar a las IA como si fueran seres conscientes, lo que abriría un debate sobre sus capacidades reales y nuestro concepto de empatía.

Incomodidades en las Relaciones Humanas

Las experiencias continuas con máquinas que muestran falsos signos de humanidad pueden cambiar nuestras expectativas en las interacciones humanas. Estamos habituándonos a relaciones eficaces y libres de conflicto, lo que podría traducirse en frustraciones en nuestras relaciones con otros humanos. Esto se traduce en una pérdida de paciencia ante las complejidades emocionales que nos caracterizan.

No solo se trata de nuestra interacción con la tecnología, sino del aspecto filosófico de lo que significa ser consciente. Al darle cualidades humanas a una máquina, podemos empezar a cuestionar el valor real de la vida consciente contra un simulador perfecto. Esto plantea interrogantes sobre posibles derechos de los robots y el valor de la autenticidad humana en un futuro dominado por la IA.

Interactuar con entidades no conscientes que imitan lo humano podría cambiar nuestra perspectiva sobre la comunicación y las relaciones personales. Es crucial reconocer los límites de estas tecnologías y el impacto potencial que pueden tener en nuestras conexiones humanas, tanto con ellas como entre nosotros. ¡Una realidad que nos debería hacer reflexionar seriamente!

Brasil (PT)

Brasil (PT)

Canada (EN)

Canada (EN)

Chile (ES)

Chile (ES)

Česko (CS)

Česko (CS)

대한민국 (KO)

대한민국 (KO)

España (ES)

España (ES)

France (FR)

France (FR)

Hong Kong (EN)

Hong Kong (EN)

Italia (IT)

Italia (IT)

日本 (JA)

日本 (JA)

Magyarország (HU)

Magyarország (HU)

Norge (NO)

Norge (NO)

Polska (PL)

Polska (PL)

Schweiz (DE)

Schweiz (DE)

Singapore (EN)

Singapore (EN)

Sverige (SV)

Sverige (SV)

Suomi (FI)

Suomi (FI)

Türkiye (TR)

Türkiye (TR)

الإمارات العربية المتحدة (AR)

الإمارات العربية المتحدة (AR)