Kloning av röster: En väg till att bryta bankens säkerhet

2024-12-05

Författare: Erik

Röstigenkänning har länge sålts in som en innovativ lösning för att skydda våra personliga uppgifter, men ny forskning avslöjar att denna teknik är mer sårbar än tidigare antaget. Med hjälp av avancerad AI som kan efterlikna våra röster har bedragare nu en ny och farlig metod för att kringgå säkerhetssystem som bygger på vår unika röstprofil.

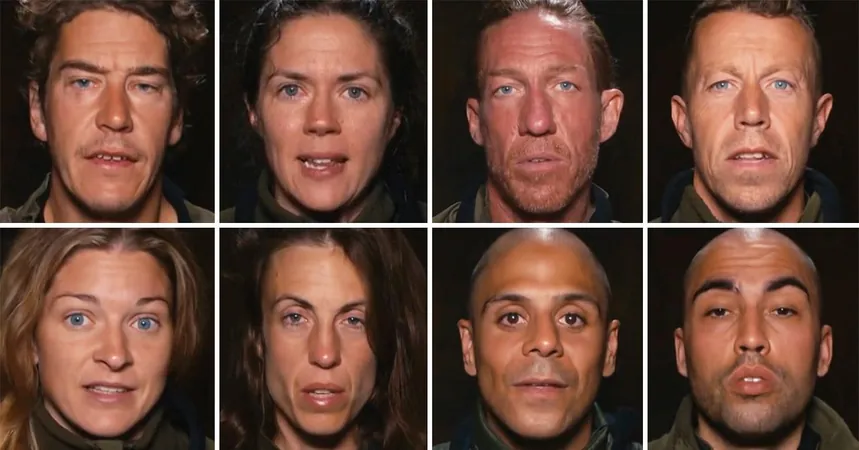

I en skrämmande demonstration av dessa teknologiska svagheter har en reporter från BBC testat gränserna för röstkloning. Genom att använda en AI-modell för att skapa en trovärdig imitation av en bankkunds röst lyckades reportern lura storbanken Santander att godkänna transaktioner utan att den riktiga kunden var medveten om det. Resultatet är en kall dusch för hela banksektorn och väcker allvarliga frågor om tillförlitligheten hos digitala säkerhetssystem.

Är vi riktigt säkra på att våra bankkonton är skyddade? Demonstrationen visar att bankernas förtroende för röstigenkänning kan vara grundat på osäkra grunder. AI-teknologiernas förmåga att klona röster och återskapa autentiska röstsignaler har knäckt en av de så kallade säkraste metoderna för autentisering.

Det är tydligt att den traditionella bankmetoden nu behöver omvärderas när röstigenkänning, som så länge ansetts vara en säkerhetsnyckel, blivit ett potentiellt hot. Privata bankinstitutioner hävdar att deras metoder fortfarande är säkrare än andra alternativ, men de medger att de ständigt arbetar för att förstärka sina system mot nya hot.

Men vad innebär detta för framtiden? Kan vi räkna med att våra banker fortfarande är skyddade, när AI-baserade attacker blir alltmer sofistikerade? Med teknologins framsteg är vi kanske tvungna att ifrågasätta och uppdatera hur vi skyddar våra mest värdefulla tillgångar.

Konsumenterna måste vara medvetna och informerade om dessa risker och aktivt söka alternative autentiseringsmetoder som fortlöpande säkerställs mot dessa nya hot. Det är dags att vi tar detta på allvar – våra ekonomiska liv hänger på det!

Brasil (PT)

Brasil (PT)

Canada (EN)

Canada (EN)

Chile (ES)

Chile (ES)

España (ES)

España (ES)

France (FR)

France (FR)

Hong Kong (EN)

Hong Kong (EN)

Italia (IT)

Italia (IT)

日本 (JA)

日本 (JA)

Magyarország (HU)

Magyarország (HU)

Norge (NO)

Norge (NO)

Polska (PL)

Polska (PL)

Schweiz (DE)

Schweiz (DE)

Singapore (EN)

Singapore (EN)

Sverige (SV)

Sverige (SV)

Suomi (FI)

Suomi (FI)

Türkiye (TR)

Türkiye (TR)