¿El Caos de la IA Open Source? La Batalla entre Puristas y Empresas Continúa

2024-10-10

Autor: Laura

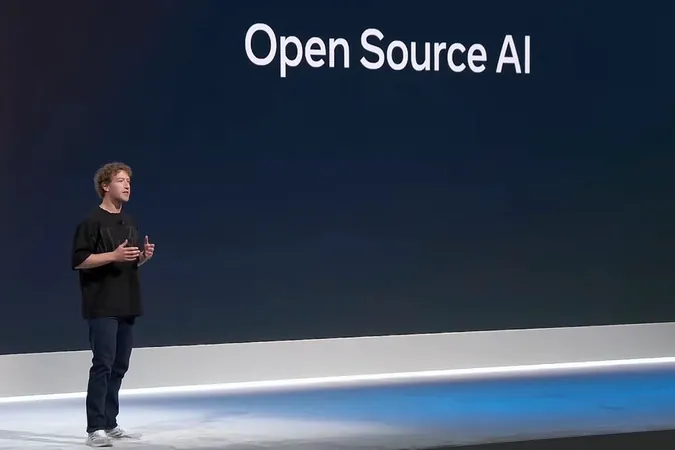

La definición de Open Source ha sido clara y bien establecida durante años. Sin embargo, la falta de consenso sobre lo que constituye realmente una IA Open Source ha desencadenado un intenso debate, con muchos proclamando que sus modelos son Open Source cuando probablemente no lo sean. Un ejemplo prominente de esta confusión es Meta.

La Open Source Initiative (OSI), responsable de la definición original del término, está trabajando actualmente para crear una definición universal y estándar de lo que se considera IA Open Source. Recientemente, la OSI ha anunciado la publicación de la primera versión candidata (RC1) de esta definición, en la que se establecen cuatro libertades fundamentales que debe tener un sistema de IA para ser considerado Open Source:

1. La capacidad de ser usada para cualquier propósito sin necesidad de permiso.

2. La posibilidad de estudiar y analizar su funcionamiento.

3. La opción de ser modificada para cualquier finalidad.

4. La habilidad de ser compartida, ya sea con o sin modificaciones.

Sin embargo, esta propuesta ha generado una gran división entre puristas y defensores de una interpretación más flexible del concepto. La OSI ha mostrado disposición a ceder en algunos aspectos, especialmente en la problemática relacionada con los datos de entrenamiento. Reconocen que no siempre es viable para las empresas compartir detalles completos sobre los conjuntos de datos utilizados para entrenar sus modelos. Por ello, en la RC1 se exige "información suficientemente detallada sobre los datos usados para entrenar el sistema" en lugar de la publicación completa de los conjuntos de datos. Este enfoque busca equilibrar la transparencia con las consideraciones legales y prácticas.

Para los puristas, no obstante, esta medida no es suficiente. Argumentan que si un sistema de IA no proporciona acceso total a los datos que utiliza, entonces no puede ser considerado realmente Open Source. La OSI se defiende diciendo que imponer la obligación de irrestricto acceso a la información podría empujar la IA Open Source a un nicho muy limitado que solo utilice datos abiertos.

La búsqueda de una transparencia total se percibe como una utopía. Stefano Maffulli, director de la OSI, ha descrito los datos de entrenamiento como clasificables en cuatro categorías: abiertos, públicos, obtenibles y no compartibles, cada una con diferentes requisitos legales. El razonamiento de la OSI sostiene que compartir datos en su totalidad es un desafío considerable.

Además de la presión de los puristas, las empresas también presentan sus propias preocupaciones. Estas consideran que sus métodos de recolección y filtrado de datos son secretos comerciales. Revelar dicha información podría equivaler a que Microsoft compartiera el código fuente de Windows en los años 90.

Dos innovaciones notables han sido integradas en esta versión de la definición. Primero, se requiere que el modelo proporcione información suficiente para entender cómo se realizó el entrenamiento, permitiendo la creación de variaciones ("forks") de sistemas de IA. Segundo, se permite a los creadores exigir condiciones de copyleft, propiciando el uso y distribución libre de obras relacionadas con el código, los datos y los parámetros de la IA de código abierto.

La publicación de esta primera versión candidata representa un avance importante hacia un consenso, aunque aún quedan aspectos por resolver. Se espera que la versión final de esta definición de IA Open Source sea presentada el 28 de octubre en la conferencia All Things Open. Sin embargo, esto será solo el inicio de un camino aún lleno de desafíos y debates.

La llegada del IA Open Source al mundo tecnológico es inminente, pero ¿estaremos preparados para el caos que puede surgir de una definición en constante evolución?

Brasil (PT)

Brasil (PT)

Canada (EN)

Canada (EN)

Chile (ES)

Chile (ES)

España (ES)

España (ES)

France (FR)

France (FR)

Hong Kong (EN)

Hong Kong (EN)

Italia (IT)

Italia (IT)

日本 (JA)

日本 (JA)

Magyarország (HU)

Magyarország (HU)

Norge (NO)

Norge (NO)

Polska (PL)

Polska (PL)

Schweiz (DE)

Schweiz (DE)

Singapore (EN)

Singapore (EN)

Sverige (SV)

Sverige (SV)

Suomi (FI)

Suomi (FI)

Türkiye (TR)

Türkiye (TR)