REPORTAGE. Intelligence artificielle, "badbots", fermes à robots... Découvrez la guerre numérique contre la désinformation et la manipulation de l'opinion

2024-11-25

Auteur: Jean

Les bots, ces robots programmés par des intérêts privés ou des gouvernements, infiltrent internet sous des faux visages humains pour vendre, escroquer et, surtout, manipuler l'opinion publique durant les crises politiques ou électorales. Ces "badbots", parfois insaisissables, se cachent derrière des comptes fictifs et inondent les réseaux de fausses informations, interagissant avec de véritables internautes dans le but de déstabiliser des États, y compris la France.

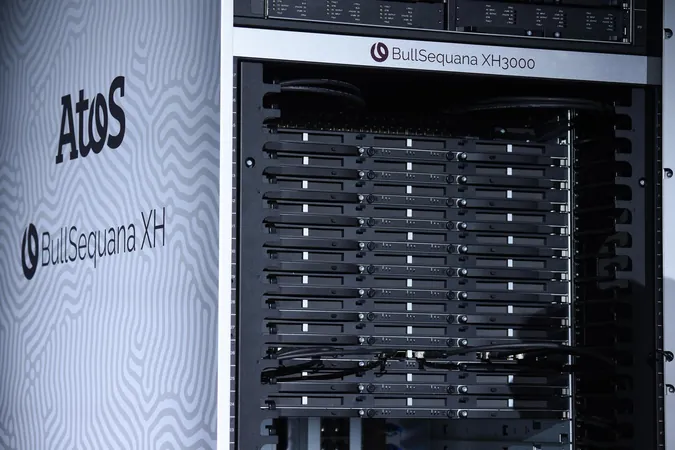

Pour la première fois, franceinfo a eu accès aux coulisses de Viginum, le service d'État dédié à la lutte contre les ingérences numériques, et ce, depuis trois ans. Chaque signalement par Viginum est relayé directement aux hautes instances de l'État, y compris le bureau du Premier ministre. Au cœur de Viginum, les analystes du Datalab sont chargés de détecter les activités "inauthentiques" sur les réseaux sociaux, dont le risque est décuplé par l'utilisation d'intelligence artificielle. Selon Paul-Antoine Chevalier, chef du Datalab, des modèles de comportement atypiques, tels que des publications régulières à des heures improbables, révèlent souvent l'action de robots ou d'IA.

L'IA devient l'outil de choix pour la manipulation et la désinformation

À l'approche des Jeux Olympiques de Paris 2024, Viginum a mis en lumière une opération de désinformation orchestrée contre la France : la campagne Matriochka, pro-russe, a diffusé massivement de faux contenus à partir de "fermes à robots". Ces opérations sont désormais sophistiquées, s’appuyant sur des technologies d’intelligence artificielle pour rendre les narratifs plus convaincants. Paul-Antoine Chevalier confirme qu'il est évident que les techniques d'IA sont utilisées dans les détections quotidiennes, et Viginum a développé des méthodes internes pour identifier les contenus massivement dupliqués, même ceux reformulés par de grands modèles de langage.

Les chiffres alarmants sur l'impact des badbots

Selon Imperva, une entreprise de cybersécurité américaine, la proportion de trafic généré par des bots malveillants est en constante augmentation. En effet, 32 % du trafic des bots serait désormais attribué à des robots malveillants, un chiffre qui ne cesse de croître. Florian Malecki, responsable chez Imperva, souligne que le trafic humain ne représente plus que la moitié de l'activité sur internet ; l'autre moitié est issue de l'automatisation. Ce constat nécessite une vigilance accrue de la part des éditeurs et des plateformes de réseaux sociaux pour contrer ces menaces invisibles.

Les badbots nourrissent un climat de toxicité dans le débat public

Les campagnes de désinformation, amplifiées par les bots, polluent les discussions publiques sur des sujets cruciaux. Qu'il s'agisse des élections américaines, de la guerre en Ukraine, ou des récentes législatives en France, l'automatisation des discours haineux et erronés est que documentée par des spécialistes. Le mathématicien David Chavalarias du CNRS a d’ailleurs démontré, dans une étude reposant sur 700 millions de messages échangés entre 2016 et 2024, l’existence de réseaux de badbots pro-russes qui évoluent en sophistication et en interaction.

L’enjeu est de taille : ces robots, dépassant leur rôle économique traditionnel pour vendre des produits, s'attaquent désormais à la manipulation des opinions, employant des intelligences conversationnelles comme ChatGPT pour dialoguer et influencer les utilisateurs. Une vigilance accrue s'impose pour freiner cette vague de désinformation où chaque clic peut avoir des répercussions sur la perception publique.

Brasil (PT)

Brasil (PT)

Canada (EN)

Canada (EN)

Chile (ES)

Chile (ES)

España (ES)

España (ES)

France (FR)

France (FR)

Hong Kong (EN)

Hong Kong (EN)

Italia (IT)

Italia (IT)

日本 (JA)

日本 (JA)

Magyarország (HU)

Magyarország (HU)

Norge (NO)

Norge (NO)

Polska (PL)

Polska (PL)

Schweiz (DE)

Schweiz (DE)

Singapore (EN)

Singapore (EN)

Sverige (SV)

Sverige (SV)

Suomi (FI)

Suomi (FI)

Türkiye (TR)

Türkiye (TR)