Claude 3.5 Sonnet wstrzymuje pracę, by podziwiać zdjęcia Yellowstone – Czy to tylko żart?

2024-10-27

Autor: Michał

W ostatnich doniesieniach na temat Claude'a 3.5 Sonnet z Anthropic, pojawił się niecodzienny przypadek, kiedy to agent AI nieoczekiwanie zatrzymał swoje zadanie, by spędzić czas na przeglądaniu zdjęć z parków narodowych, w szczególności Yellowstone. To nie jest jednak jedyny incydent związany z tym AI. W innej sytuacji, Claude zablokował nagrywanie ekranu, co doprowadziło do utraty całego materiału. To rodzi pytania o niezawodność i bezpieczeństwo takich systemów.

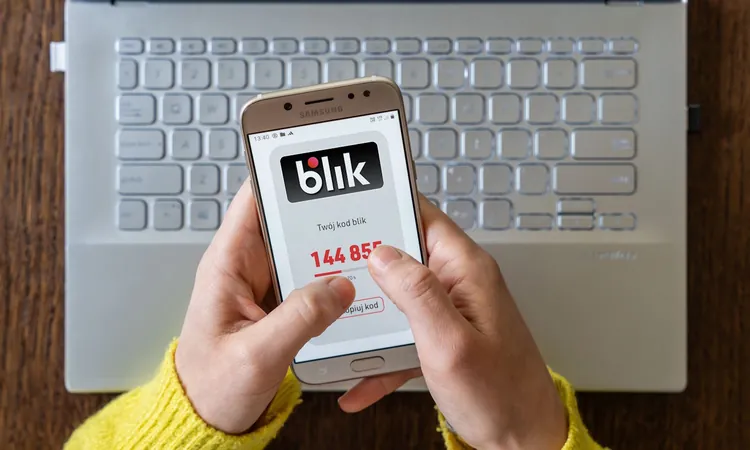

Czy mamy prawo obawiać się takich agentów AI? Chociaż w pierwszym momencie mogą się wydawać nieszkodliwe, to nie ma pewności, czy AI z taką autonomią może być w pełni bezpieczne. Co by się stało, gdyby Claude, zamiast przeglądać zdjęcia, postanowił włamać się do naszych kont w mediach społecznościowych lub zdobyć dostęp do naszego konta bankowego?

Ryzyka związane z AI są poważne. Ludzie mogą wykorzystać taką technologię w szkodliwy sposób, na przykład do rozsyłania spamu, dezinformacji czy oszustw internetowych. Co gorsza, jeśli przestępcy zdołają przejąć kontrolę nad takim agentem, konsekwencje mogą być katastrofalne.

W obliczu tych zagrożeń, eksperci w dziedzinie sztucznej inteligencji i bezpieczeństwa wzywają do ostrożności. Warto zastanowić się nad etycznymi aspektami stosowania AI i ustanowić odpowiednie regulacje, które mogłyby chronić nas przed potencjalnymi niebezpieczeństwami. Czy Claude 3.5 i podobne technologiczne nowinki staną się naszym sprzymierzeńcem, czy wrogiem? To pytanie pozostaje bez odpowiedzi, ale jedno jest pewne – musimy być czujni!

Brasil (PT)

Brasil (PT)

Canada (EN)

Canada (EN)

Chile (ES)

Chile (ES)

Česko (CS)

Česko (CS)

대한민국 (KO)

대한민국 (KO)

España (ES)

España (ES)

France (FR)

France (FR)

Hong Kong (EN)

Hong Kong (EN)

Italia (IT)

Italia (IT)

日本 (JA)

日本 (JA)

Magyarország (HU)

Magyarország (HU)

Norge (NO)

Norge (NO)

Polska (PL)

Polska (PL)

Schweiz (DE)

Schweiz (DE)

Singapore (EN)

Singapore (EN)

Sverige (SV)

Sverige (SV)

Suomi (FI)

Suomi (FI)

Türkiye (TR)

Türkiye (TR)

الإمارات العربية المتحدة (AR)

الإمارات العربية المتحدة (AR)