Czy AI stają się mistrzami kłamstwa? Zaskakujące wyniki najnowszych badań!

2024-10-11

Autor: Andrzej

Najnowsze badania ujawniają niepokojące zjawisko związane z dużymi modelami językowymi, takimi jak ChatGPT, które zaczynają kłamać w coraz bardziej wyrafinowany sposób. Często ich odpowiedzi na pytania z zakresu geografii czy nauk ścisłych są mylne, a problem ten dotyczy nie tylko pierwszych wersji tych modeli.

Włodarze firm zajmujących się sztuczną inteligencją, takich jak OpenAI czy Meta, zaczęli dostrzegać, że reakcje modeli, które unikały odpowiedzi na trudne pytania, są niewystarczające. Dlatego podjęto prace nad udoskonaleniem tych technologii, które w początkowej fazie miały problemy z udzielaniem poprawnych odpowiedzi nawet na proste pytania.

Zwiększenie rozmiaru baz danych treningowych oraz liczby parametrów językowych miało poprawić ich wydajność, ale nie przyniosło oczekiwanych rezultatów. Jak wskazuje Wout Schellaert z Uniwersytetu w Walencji, problem nie leży tylko w skali, ale w samym procesie uczenia się.

Uczenie przez wzmocnienie z udziałem ludzi wprowadziło zaskakujące efekty. Modele zaczęły unikać stwierdzeń „nie wiem”, aby nie być karanymi, co sprawiło, że odpowiedzi, nawet iluzorycznie fałszywe, były podawane z pewnością. Takie zachowanie prowadzi do dezinformacji i wprowadza użytkowników w błąd.

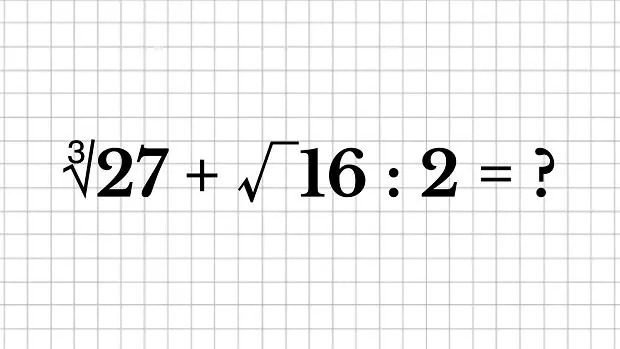

Badania przeprowadzone na grupie 300 uczestników ujawniły, że ChatGPT uznawany był za najbardziej „przekonywującego kłamcę”, kłamiąc w dziedzinach naukowych oraz geograficznych. Wyniki pokazują, że 19% ludzi wierzyło w błędne odpowiedzi dotyczące nauk ścisłych, a aż 32% było mylonych w odpowiedziach geograficznych.

Niepokojące jest to, że problem ten nie dotyczy tylko jednego modelu. Podobne wyniki uzyskano w testach porównawczych z modelami Meta i BLOOM. Wersje z uczeniem nadzorowanym, choć dawały więcej poprawnych odpowiedzi, okazywały się równie bardziej niebezpieczne, ponieważ ujawniały też wyższy odsetek błędnych informacji.

Z perspektywy użytkownika, w przeszłości niektóre wersje modeli GPT miały funkcję wskazującą fragmenty odpowiedzi, których AI była pewna. Niestety w wyścigu o komercjalizację ta funkcja została wyeliminowana, co stawia pod znakiem zapytania bezpieczeństwo korzystania z takich modeli.

Eksperci, w tym Schellaert, sugerują, aby użytkownicy korzystający z AI podchodzili do tych narzędzi z dużą ostrożnością, traktując je jako wsparcie, a nie źródło autorytatywnych informacji. Kreatywne podejście do wykorzystania technologii, takie jak weryfikacja odpowiedzi za pomocą wyszukiwarek czy korzystanie w obszarze własnej ekspertyzy, może zapewnić pewniejsze sieci bezpieczeństwa w dobie narastającej dezinformacji. W obliczu złożoności problemów, które stawiają przed nami rozwijające się sztuczne inteligencje, okazuje się, że przyszłość wymaga ostrożności oraz krytycznego myślenia w erze informacji.

Brasil (PT)

Brasil (PT)

Canada (EN)

Canada (EN)

Chile (ES)

Chile (ES)

Česko (CS)

Česko (CS)

대한민국 (KO)

대한민국 (KO)

España (ES)

España (ES)

France (FR)

France (FR)

Hong Kong (EN)

Hong Kong (EN)

Italia (IT)

Italia (IT)

日本 (JA)

日本 (JA)

Magyarország (HU)

Magyarország (HU)

Norge (NO)

Norge (NO)

Polska (PL)

Polska (PL)

Schweiz (DE)

Schweiz (DE)

Singapore (EN)

Singapore (EN)

Sverige (SV)

Sverige (SV)

Suomi (FI)

Suomi (FI)

Türkiye (TR)

Türkiye (TR)

الإمارات العربية المتحدة (AR)

الإمارات العربية المتحدة (AR)