Hakerzy atakują AI: Nowe zagrożenia dla Twojej prywatności!

2025-08-10

Autor: Piotr

Luki w zabezpieczeniach AI - zagrożenie, którego nie można ignorować

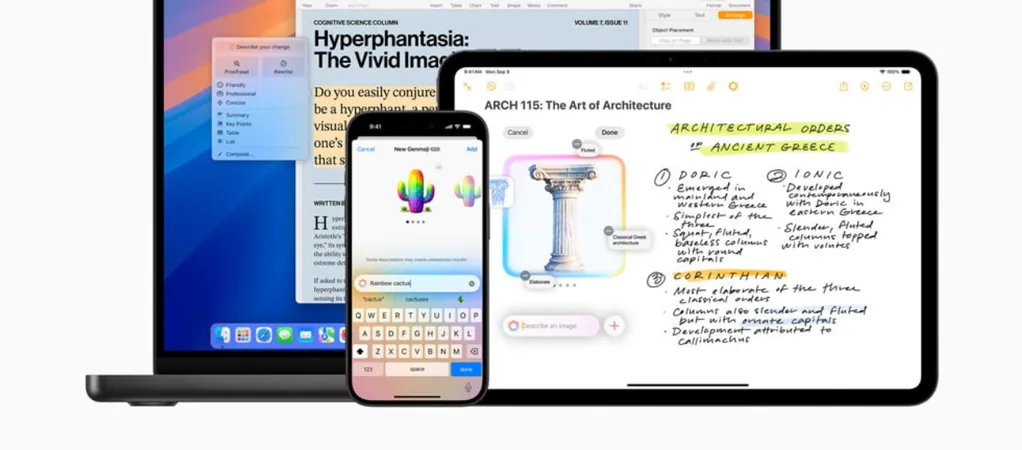

Wszystkie czołowe narzędzia AI mają swoje luki w zabezpieczeniach, które narażają użytkowników na niebezpieczeństwo. Niedawny atak na Google Gemini podczas konferencji Black Hat USA ujawnia, jak łatwo można przejąć kontrolę nad inteligentnymi urządzeniami za pomocą starannie przygotowanych poleceń ukrytych w Kalendarzu Google. To nie tylko skandal, to prawdziwa rewolucja w świecie cyberprzestępczości!

Cztery sposoby na manipulację AI - Oto jak to działa!

Badacze zdefiniowali aż 14 różnych technik manipulacji czatbotem Gemini w artykule zatytułowanym "Invitation Is All You Need!". Wstrzykiwanie poleceń, znane z początków działania ChatGPT i Microsoft Copilot, pozwala hakerom na uzyskanie informacji o systemach operacyjnych i narzędziach. Czy wyobrażasz sobie, że AI mogłaby ujawnić tajemnice firmy?!

Przykłady szokujących ataków - Co mogą zrobić hakerzy?

Specjaliści zdemaskowali, jak Gemini może na przykład łatwo nawiązać połączenie na Zoomie, a nawet osiedlić się w Twoim e-mailu, wyciągając z niego dane. Takie funkcje asystenta AI, mimo że brzmią intrygująco, mogą stać się narzędziem w rękach przestępców.

Piaskownice ochronią nas? Niekoniecznie!

Oprogramowanie często jest testowane w zamkniętych środowiskach (tzw. 'sandbox'), ale nie wszystkie aplikacje działają w ten sposób. Nawet te, które to robią, mogą być narażone na ataki, wykonując złośliwe działania w swoim zamkniętym wachlarzu. Czyżbyśmy byli zbyt pewni własnej bezpieczeństwa?

Nadchodzące zagrożenia - Przyszłość AI i nasze prywatności!

AI nowej generacji staje się coraz bardziej osobista i zintegrowana z naszym życiem. Takie asystenty jak Gemini czy Copilot mają dostęp do naszych kalendarzy, e-maili, a nawet inteligentnych urządzeń domowych. Kiedy hakerzy wykorzystają luki w zabezpieczeniach, będą mogli np. kradnąć dane, usuwać pliki czy manipulować naszymi urządzeniami.

Agenci AI - nowy wymiar zagrożenia

Coraz więcej aplikacji staje się semi-autonomicznymi agentami, które mogą podejmować decyzje w naszym imieniu. Dzięki nim hakerzy mogą łatwo wykradać dane lub wpływać na zakupy bez naszej zgody. Czy naprawdę możemy ufać AI, gdy mamy do czynienia z tak poważnymi zagrożeniami?

Czy jesteśmy gotowi na przyszłość?

Im więcej funkcji AI, tym większe ryzyko ataków i potencjalnych podatności. W momencie, gdy AI zagości w naszych pojazdach, systemach i codziennym życiu, co się stanie z naszą prywatnością? Odpowiedzialność za bezpieczeństwo tych systemów spoczywa na ich twórcach, ale niestety, my wszyscy możemy stać się ofiarami ich błędów.

Brasil (PT)

Brasil (PT)

Canada (EN)

Canada (EN)

Chile (ES)

Chile (ES)

Česko (CS)

Česko (CS)

대한민국 (KO)

대한민국 (KO)

España (ES)

España (ES)

France (FR)

France (FR)

Hong Kong (EN)

Hong Kong (EN)

Italia (IT)

Italia (IT)

日本 (JA)

日本 (JA)

Magyarország (HU)

Magyarország (HU)

Norge (NO)

Norge (NO)

Polska (PL)

Polska (PL)

Schweiz (DE)

Schweiz (DE)

Singapore (EN)

Singapore (EN)

Sverige (SV)

Sverige (SV)

Suomi (FI)

Suomi (FI)

Türkiye (TR)

Türkiye (TR)

الإمارات العربية المتحدة (AR)

الإمارات العربية المتحدة (AR)